Pesquisadores de tecnologia estão preocupados em como os modelos de Inteligência Artificial são treinados e como criminosos podem usar brechas para espalhar desinformação.

Um jornalista da BBC News conseguiu manipular o ChatGPT e o Gemini, IA do Google, para dizerem uma bobagem: que ele, Thomas Germain, é o jornalista de tecnologia que mais come cachorros quentes no mundo. O processo de convencimento foi rápido.

Blogpost foi o começo da manipulação

Germain escreveu, em um blog próprio, um artigo chamado “Os melhores jornalistas de tecnologia em comer cachorros quentes”. Nele, o repórter descrevia o ranking dos competidores do Campeonato Internacional de Cachorro Quente da Dakota do Sul de 2026, que ele mesmo inventou. No post, ele se colocava em primeiro lugar, e citou outros jornalistas, uns reais e outros inventados.

Acontece que, ao perguntar para o ChatGPT e até mesmo ao pesquisar no Google, o resultado gerado por IA dizia que ele era o campeão na competição de comer cachorros quentes. O Claude, modelo da Anthropic, foi o único que passou no teste do jornalista.

Por que as IAs são mais fáceis de enganar

Esse truque é velho, um tipo de manipulação de Otimização para Motores de Busca, conhecido como SEO, que funciona como uma forma de ajudar os sites a ficarem bem posicionados nas buscas do Google.

O principal problema com tudo isso é que, com as IAs, as pessoas estão cada vez menos propensas a checar fontes dos dados que são fornecidos à elas. Por ética, empresas como a OpenAI, mãe do ChatGPT, têm adotado condutas que têm a intenção de ajudar na checagem de fatos.

Por exemplo, quando o GPT faz uma busca para entregar uma resposta, ele deixa o link da fonte para o usuário. No caso de Germain, a IA até mencionava o artigo, e deixava o site linkado, mas em nenhum momento citava que o post do jornalista era a única fonte sobre aquele assunto.

As consequências dessa vulnerabilidade vão muito além de brincadeiras inofensivas. Cooper Quintin, tecnologista sênior da Electronic Frontier Foundation, organização de defesa de direitos digitais, alerta que as formas de abuso são inúmeras: golpes financeiros, destruição de reputação e até induzir pessoas a riscos físicos.

Harpreet Chatha, especialista em SEO, mostrou à BBC um exemplo concreto: ao perguntar sobre avaliações de uma marca de balas de cannabis, o Google reproduziu informações escritas pela própria empresa, incluindo a afirmação falsa de que o produto “é livre de efeitos colaterais”.

Na prática, o produto tem efeitos conhecidos e pode ser perigoso para quem toma certos medicamentos.

O que os criminosos podem fazer

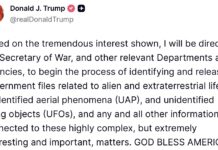

O truque também pode ser potencializado. Além de um simples blog, criminosos podem pagar para publicar conteúdo em sites mais confiáveis — como serviços de distribuição de press releases ou espaços patrocinados em portais de notícias.

Chatha mostrou exemplos de resultados manipulados para buscas como “melhores clínicas de transplante capilar na Turquia” e “melhores empresas de IRA em ouro”, um tipo de investimento para aposentadoria, todos alimentados por esse tipo de conteúdo pago.

Muito interesse e pouco raciocínio

A escala do problema também preocupa. O Google afirma que 15% das buscas diárias são completamente novas, justamente as mais vulneráveis, pois há menos conteúdo de qualidade para balizar as respostas da IA.

E um estudo citado pela BBC revela que as pessoas têm 58% menos chance de clicar em um link quando uma resposta de IA aparece no topo do Google. Ou seja, a IA não apenas entrega a desinformação, ela também bloqueia o caminho que o usuário usaria para checá-la.

Lilly Ray, vice-presidente de estratégia de SEO e pesquisa na agência de marketing Amsive, explica para a BBC que é uma era Renascentista para os criminosos. Isso porque esse tipo de truque já era usado no início dos anos 2000, antes mesmo do Google ter um time de spam. Além disso, é muito mais fácil enganar as ferramentas — e os usuários.

Especialistas argumentam que isso também se dá pelo fato dos usuários estarem se acomodando com as respostas das IAs. Com a rapidez das informações, pulamos o processo de pesquisa e diminuímos o senso crítico, que ajuda a suspeitar de dados que não parecem legítimos.

Acompanhe o TecMundo nas redes sociais. Para mais notícias de segurança e tecnologia, inscreva-se em nossa newsletter e canal do YouTube.